她如何把“系统2”带给了大模型

2023 年,业界还在卷Scaling Law,不断突破参数规模和数据规模时,微软亚洲研究院张丽团队就选择了另一条路径。

早在OpenAI o1发布前,张丽团队就开始探索大模型深度推理能力。

System2这个原属认知科学的词汇最早由她及团队引入大模型领域。

最近,她们通过蒙特卡洛搜索算法让7B 模型实现了o1 级别的数学推理能力。

rStar — Math的发布引发学术圈内外的广泛讨论。

△rStar-Math 论文

在当前基于 PPO/GRPO 强化学习路线主导的当下,她们的工作又将带来哪些新的可能性?

本期「大模型创新架构」主题访谈,量子位邀请到rStar-Math 作者微软亚洲研究院首席研究员张丽,聊聊突破大模型智商上限、奖励模型以及 System2 背后的故事。

张丽,MSRA 系统研究组首席研究员,微软 LongRoPE 及 rStar 系列工作项目 leader。

△微软亚洲研究院系统研究组首席研究员张丽

以下为量子位与rStar-Math 作者微软亚洲研究院首席研究员张丽的对话实录整理:

智商突围

量子位:能简单介绍下 rStar-Math 的核心工作吗?当初为什么选择这个研究方向?

MSRA 张丽:一直以来我们主要沿着如何提升大语言模型的智商这个大方向在持续做研究,具体分两个方向:

一个是让模型具备无限且持久的记忆能力,另一个是提升模型的深度推理逻辑思考能力。

我们 2025 年 1 月发布的rStar-Math工作,简单说是第一个公开通过蒙特卡洛搜索算法,让7B模型实现了接近OpenAI o1 级别的数学推理能力的工作。

我们当时做这个工作的时候,整个行业趋势还是在卷scaling law,认为模型 size 越大,数据量越多,效果越好。

但我们发现,尽管隔一段时间就有新体量的模型推出,但实际上模型的数学深度推理能力一直没有显著提升。

量子位:在 2024 年 o1 还没发布时你们就开始做 System2 了吗?

MSRA 张丽:对,应该是2023 年 5 月份左右。

2022 年 11 月ChatGPT出来时,大家都被震惊了,但是我们发现它仍然在有些方面做得不够好。

作为研究员,我们比较注重逻辑推理思考能力,所以很自然会希望大语言模型能像我们一样具备很强的推理能力。

我们最初的思路是两点:

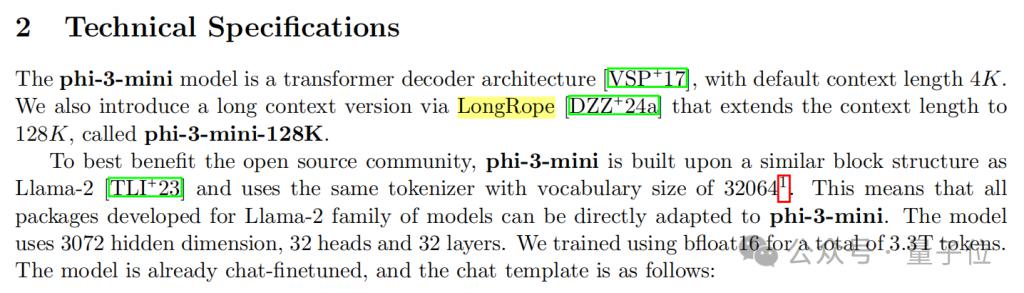

一是希望模型在解题时能够利用很长的" 草稿纸 ",所以我们做了LongRoPE,拓展大模型长文本的推理窗口。

△LongRoPE 论文于 2024 年 2 月发表

二是要有效利用这个草稿纸,这就需要像人一样的深度推理思考方式,这就有了rStar 系列工作。

△rStar-Math 前身,rStar 论文于 2024 年 8 月发表

量子位:最早将 System2 这个人脑认知科学词汇引入大模型领域的是谁?

MSRA 张丽:可能是我们吧。更准确地说,当我们想定义这种能力时,从人脑认知科学中找到了这个可以类比的词。

量子位:当时为什么认为 System2 会是未来非常重要的研究方向?

MSRA 张丽:我们觉得,大语言模型真正要落地应用,或者实现通用,其他能力可能都好说,智商或推理能力才是最关键因素。

看各行各业的顶尖人才,他们的专业领域不同,有人擅长解数学题,有人擅长写代码,有人写作或口才好,但本质上他们都有很强的推理能力,这就是智商。

大模型有了这个基础,再去做其他应用,让大模型落地或提高社会生产力,都会变得简单得多。

△System1&2(快反应与慢思考)区别示意

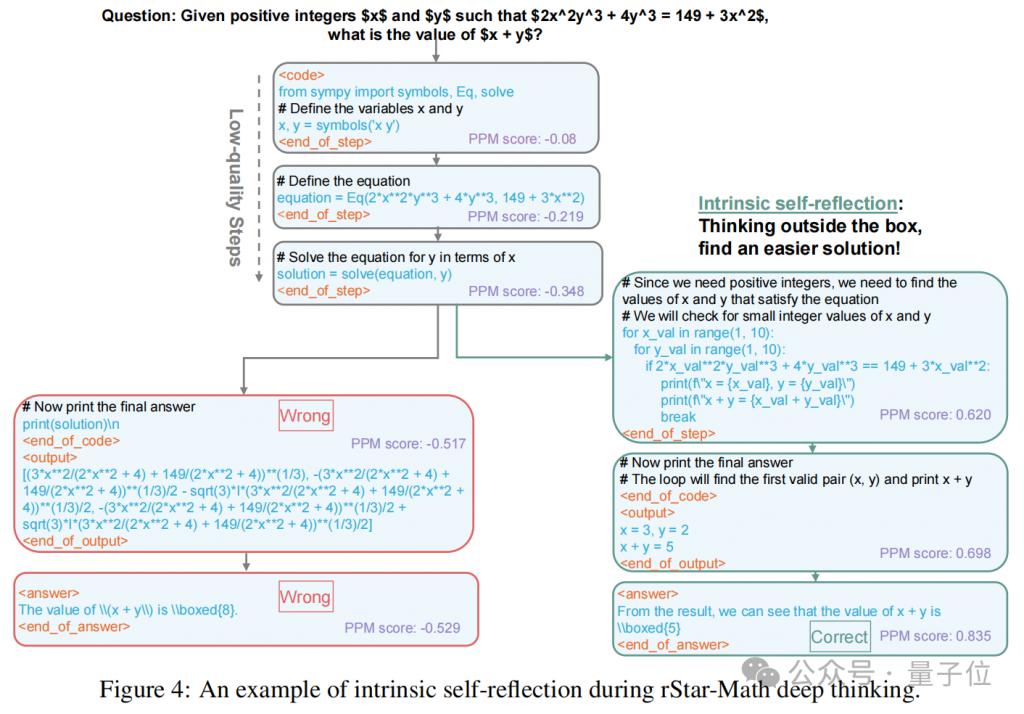

量子位:rStar-Math 在研究过程中模型自己涌现出了 self-reflection 能力,这意味着什么?

MSRA 张丽:这其实并不是有意为之,是意外收获。后来想想,可能间接验证了self-reflection 是提升大模型智商的关键能力这一点。

这种自我修正或自我反思是人类做很多事情都会使用的思维方式,可以说是一种必备能力。

我们确实没有刻意追求复现 "aha moment",但这在当时确实是个机会,很多团队都想复现,最后发现强化学习可以激发出这种能力。

量子位:激发大模型 self-reflection 能力的关键是什么?

MSRA 张丽:我个人认为,大模型预训练数据中本来就包含人类自我反思过程的信息。

互联网上的大量数据中会自然混入一些这样的内容,因为这是人类基本的高级思考模式。

大模型经过预训练记住这些模式后,强化学习或蒙特卡洛搜索算法会将这种能力激发出来。

在解决复杂问题过程中,模型发现用了 self-reflection 后效果更好,蒙特卡洛算法就会把这些标记为高质量数据;

如果是强化学习,模型发现用了 self-reflection 后能答对,就会给这个策略更高分数。最终结果都是让模型涌现出这种能力。

△rStar-Math 涌现 self-reflection 能力蒙特卡洛突破

量子位:rStar-Math 发布后反响很大,有什么印象深刻的反馈吗?

MSRA 张丽:确实 rStar-Math 比我们之前的工作受到了更多关注,完全超出了我的预期。

我想可能是因为当时 o1 已经出来好几个月,但还没有哪份公开的报告能说清楚它是怎么做到的。

我知道有很多人也在用类似的蒙特卡洛搜索算法,但没有达到 o1 水平的效果。

而我们恰好做到了,而且方法上有一些创新,可能是这个原因会突然受到关注。

感觉有点" 破圈 " 效应。学术圈通常只有做同方向的人才会关注你的工作,但那时很多不做这个方向的同事朋友都发微信说某某看了我们工作想认识一下,这种情况很少见。

还有很多媒体,国内外的,都要采访我们。在X上也有大量讨论,一些人给了很高评价,认为用 7B 模型就能达到 OpenAI o1 级别表现非常不可思议。

也有人讨论2025 年会不会是小模型的时代,还引发了关于scaling law与其他路线的新一轮辩论。

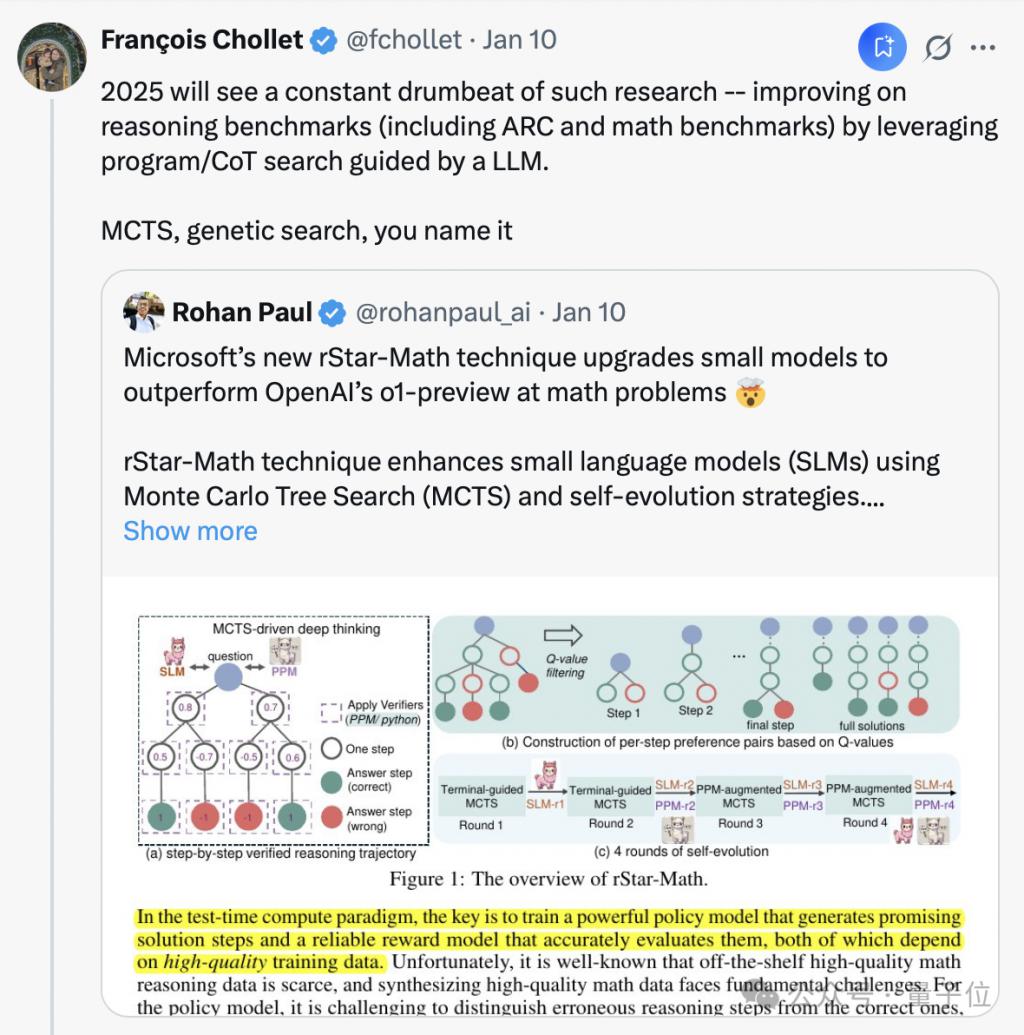

△Keras 创始人 Fran ç ois Chollet 评价 rStar-Math

量子位:有没有遇到质疑的声音?

MSRA 张丽:当然有,大概分两个阶段。

一开始在DeepSeek R1和Kimi 1.5出来之前,主要质疑是" 小模型能力怎么会这么强 "以及" 这个方法能否泛化到其他任务 ",所以后来我们开源了代码和数据。

后来,DeepSeek R1 和 Kimi 1.5 出来了,有人开始讨论复现 OpenAI o1 效果到底是否真的需要蒙特卡洛搜索。这些质疑都很合理,因为每个人观点不同。

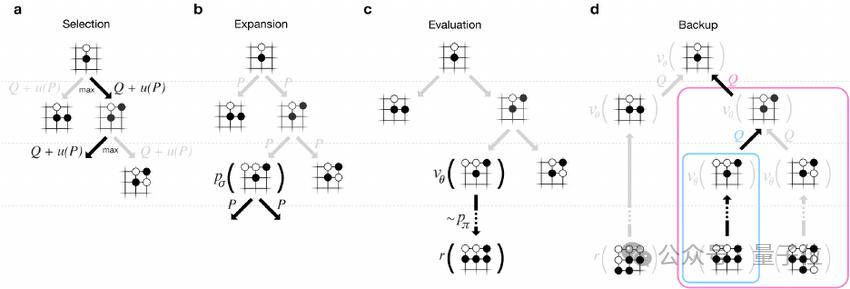

量子位:蒙特卡洛搜索算法的奖励模型和传统 Best of N 奖励模型的根本区别是什么?

MSRA 张丽:根本区别是蒙特卡洛搜索算法的奖励模型是步骤级别的,是过程奖励模型。

Best of N 是结果奖励模型,不关注过程,所以蒙特卡洛搜索算法效果更好。

量子位:为什么蒙特卡洛搜索算法在小模型上表现这么好?效果会不会仅限于小模型?

MSRA 张丽:它在小模型上表现优异,反而说明了它有很大潜力。

我们2024 年 8 月发布初版 rStar时就发现了蒙特卡洛算法潜力巨大。

当时我们没有进行任何训练,甚至没有训练奖励模型,只是在小模型上应用蒙特卡洛搜索算法,发现效果非常好,甚至能与做了特殊微调后的模型效果相当。

因为 System2 是更高级的思维模式,有一定门槛,策略模型不能太差,而小模型作为策略模型本身就较弱。

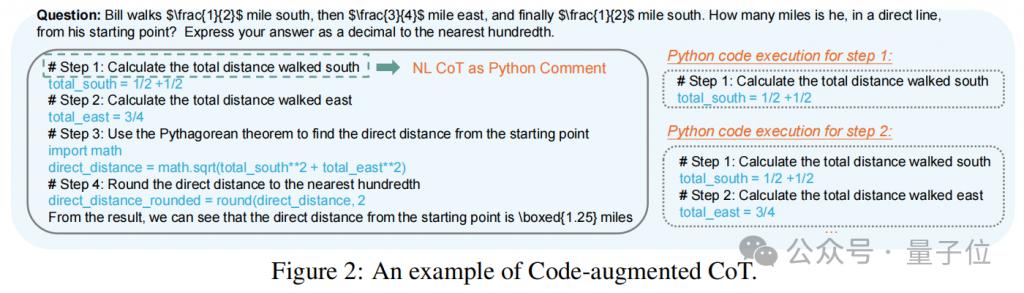

所以为了解决小模型效果不理想的问题,如幻觉等,我们唯一做的就是加了code-augmented CoT,尽量让蒙特卡洛搜索算法效果发挥到极致。

△rStar-Math 使用 code-augmented CoT 示例

量子位:在你们的工作发布前,蒙特卡洛搜索算法是主流方案吗?

MSRA 张丽:之前它不是很主流,但学术界确实有一些工作开始关注这个方向。

量子位:o1 及你们的工作发布后,这种方法变得更主流了吗?

MSRA 张丽:目前还没看到这种趋势,大多数人还是在做强化学习。不过我知道一些其他领域的人也在尝试蒙特卡洛搜索算法。

由于我们的工作受到关注,有人联系我们,希望将这种方法应用到金融或医疗领域。一些实际场景需要较小的模型,他们可能会考虑我们的方法。

量子位:你们做了 scaling law 实验吗?有看到你们的工作随着参数量增加效果的变化趋势吗?

MSRA 张丽:目前我们最大只做到7B,然后向下做了scaling down,尝试了3.8B和1.5B。

总体观察到的趋势是参数规模越大,效果越好。

如果模型 size 固定,我相信蒙特卡洛搜索算法比当前基于强化学习或蒸馏的方法潜力更高。

量子位:rStar-Math 在合成数据方面效果这么好,背后原因是什么?

MSRA 张丽:主要有两点。第一是 code-augmented CoT,虽然最初是为小模型设计的,但对更大模型也有用。

当然这种方法以前就有,叫Tool-Integrity Reasoning (TIR)。

△Tool-Integrity Reasoning (TIR)解读

第二是我们用了过程奖励模型配合蒙特卡洛搜索算法,会做很多 rollout,给不同步骤和每个 trace 打分。

即使是正确的 trace 中,我们也会挑选出更优的步骤,这相当于做了很好的数据筛选。

量子位:您认为奖励模型的重要性未来会成为共识吗?对奖励模型的研究会增多吗?

MSRA 张丽:我觉得会。现实中有很多任务没有明确标准答案,很难用简单规则评价。

比如写作,你几乎无法用几条规则判断好坏,肯定需要一个更强的奖励模型来打分。

对于复杂逻辑推理问题,比如数学证明也很难做好的奖励模型,因为它不只是结果对就行,必须每一步证明都正确,需要一个非常严格的过程奖励。

如果只用基于结果的强化学习,很可能出现证明结果正确但过程错误的情况。

要在提升大模型智商这个方向继续前进,一个优秀的过程奖励模型是必不可少的。

量子位:为什么优化策略模型比优化奖励模型更快?

MSRA 张丽:首先,奖励模型比策略模型更难做。奖励模型是强化学习多年来始终未完全解决的问题。

很难找到一个好的奖励模型或奖励函数去给动作或策略打分。

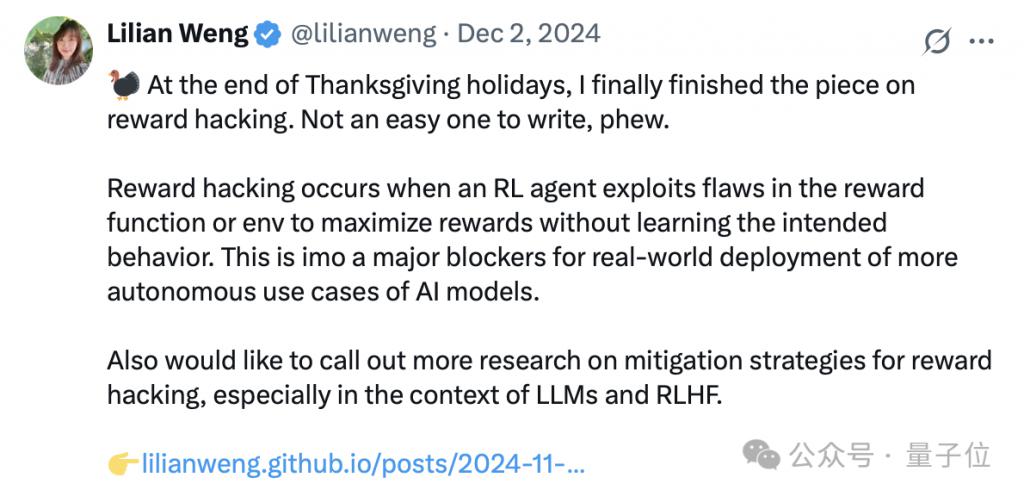

其次,奖励模型在强化学习中容易出现reward hacking问题。策略模型可能会用各种方法骗过奖励模型,实际上输出的答案并不好。

这导致强化学习无法持续进行,所以很多做强化学习的研究者会拿掉奖励模型,但本质上还是因为奖励模型目前没有很好的解决方案。

△前 OpenAI 安全团队 Leader 翁荔曾发万字长文解读 reward hacking

对于数学这样的高难度问题,奖励模型更难构建。

在一般问题中,奖励模型不那么准确可能还能接受,但在数学问题中,一步错误就会导致最终答案完全错误。

量子位:rStar-Math 对数学推理之外的其他任务有泛化性吗?

MSRA 张丽:我认为它有很强的泛化潜力。

rStar-Math 本质上是一种思路,我只需要知道每次 rollout 的结果是对还是错就可以应用。

当最终结果正确时,我就认为这次 rollout 中的每个步骤都有贡献,就会返回给它们打分,然后进行更多 rollout。

如果中间某个节点每次都能导向正确答案,那可能是个正确步骤;如果经常导向错误答案,可能就是错误步骤。

打完分后,我就能收集数据构造过程奖励模型,这就是rStar-Math 的核心思想。

它唯一的门槛是在 rollout 到根节点时需要判断这次 outcome 是否正确,这个门槛并不高,所以应用场景其实很广,泛化性没有问题。

破局与远见

量子位:rStar-Math 开源后,行业有什么反响?

MSRA 张丽:我们当然希望它能有更广泛的应用,或者有人基于我们的代码在更大模型上尝试。

目前有一些第三方联系我们,比如有家公司想用这个模型做数学 AI 教育,还有国外一些知名实验室希望在代码类和数学证明方面合作。

有趣的是,还有一家智能车厂商联系我们,希望用我们的算法在他们的模型上复现,让我们帮助解答一些问题。

量子位:您看好 rStar-Math 在工业级模型上落地吗?在通用场景中,蒙特卡洛搜索算法的搜索空间会不会太大?

MSRA 张丽:对于很简单的问题,确实没必要用这么复杂的方法。

蒙特卡洛搜索算法最初因AlphaGo而火,它可能天然更适合复杂任务。

△AlphaGo 中的蒙特卡洛搜索算法示意

对通用任务,它可以用但不一定是必要的。普通大模型一次回答可能就足够接受,不需要再用 System2 去多次搜索。

多搜索几次可能找到比一次回答更好的答案,但两者差距可能不大,从性价比上考虑可能必要性不会特别高。

量子位:下一步的研究会更关注长文本还是深推理?

MSRA 张丽:关于长文本,我们之前做LongRoPE时从算法层面提供了让预训练模型文本窗口可以拓展到无限的方案。

也在微软的 phi 系列模型上得到了验证。

△Phi-3 Technical Report 表明使用 LongRoPE

但要真正扩展到那么长的长度,还需要解决效率问题以及长文本数据和算力问题,这些不是我当前阶段关注的重点。

我们目前更关注推理能力的提升,也就是深推理这方面。

量子位:会继续研究奖励模型吗?

MSRA 张丽:下一步我们可能会做三件事。

第一是继续优化奖励模型。

第二是进一步提升策略模型能力,希望它能学会更像人类的高级推理方式,比如主动提问或 self-reflection 之外的其他推理方式。

第三是扩展任务领域,除了数学外,我们还想扩展到高难度的代码推理任务,最终实现通用的深度推理能力。

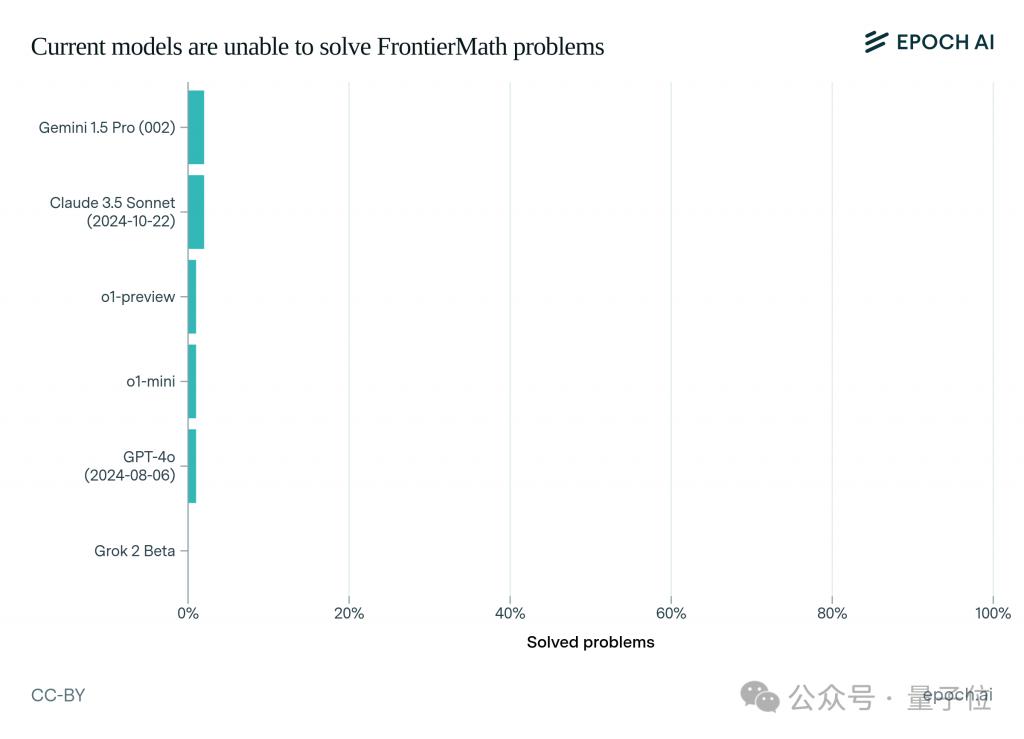

量子位:解数学题一定是智商要求最高的任务吗?

MSRA 张丽:我认为是的。数学推理基本上是大语言模型中最要求程序执行能力和逻辑严谨性的任务类型。

有些证明题数学家需要花几百年才能证明出来,我个人认为它应该是智能天花板的一种表现。

量子位:有种说法认为大家对提升数学能力的研究更多是因为它结果唯一、数据全且易验证,数学能力一定代表智商天花板吗?

MSRA 张丽:数学任务确实更容易着手研究,效果更容易验证,但要真正提升数学推理能力并不容易。

比如FrontierMath这个高难度数学基准测试,由多名数学家出题,目前最强的模型在上面的准确率也只有2%左右。

△ 主流 SOTA 模型在 FrontierMath 上的表现

当前数学研究更多是因为数据相对丰富,条件比较成熟,判定好坏更明确。

有些非证明题甚至不需要看步骤,看答案对不对就可以了,所以可能给人感觉大模型数学能力好做。

人类的其他复杂任务可能现在各方面研究条件还不够成熟,所以感觉大家都在做数学能力。

但真正让大模型成为数学家可信赖的助手,这条路还很长。

论文:https://arxiv.org/abs/2501.04519